Ученые и программисты перестали понимать, как именно принимает решения искусственный интеллект.

Эксперты сообщают, что нужно действовать уже сейчас, пока система не стала слишком сложной.

“Мы не хотим принимать за должное решения ИИ, без понимания их логики, - говорит Джейсон Йосински из Uber. - Чтобы общество приняло модели машинного обучения, мы должны знать, как ИИ принимает решения”.

Проблема, которую многие эксперты называют “черной коробочкой”, действительно серьезная. Предыдущий опыт показал, что ИИ имеет склонность принимать предвзятые решения и проводить аналогии там, где их не следовало бы проводить.

Ошибка ИИ может обойтись очень дорого, например, во время таких операций, как космическая миссия на Марс. Аппараты находятся в 200 млн миль от Земли и стоят сотни миллионов долларов, говорит Кири Вагстафф ИИ-эксперт в Jet Propolusion Lab (NASA).

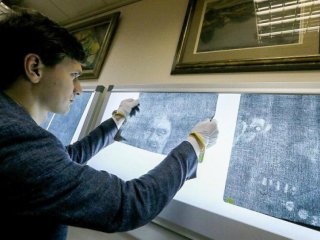

Однако ученые уже пытаются находить методы, позволяющие понять логику искусственного интеллекта. К примеру, исследователь из Google Мэтра Рагху представила доклад, в котором описывается процесс отслеживания действий отдельных “нейронов” нейросети.

Анализируя миллионы операций, ей удалось понять, какие из искусственных “нейронов” концентрировались на неверных представлениях, и отключить их.

“Это похоже на то, как школьные учителя просят детей пересказать своими словами, что они поняли из объяснений учителя”, - говорит Вагстафф.

Ранее портал “Знай.ua” собрал топ-5 мифов о пиве.