Искусственный интеллект создает массу новых возможностей в области социальных экспериментов. Но вместе с ними он создает новые угрозы для личной жизни и демократии. До сих пор разработчики руководствовались лишь собственными принципами. Однако, эксперты уверенны, что новую регуляторную базу нужно было создавать еще вчера, передает Wired.

Подпишись на наш Viber: новости, юмор и развлечения!

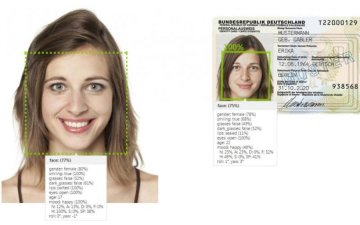

ПодписатьсяПричиной для нового витка дискуссии об этических рамках в области цифровых технологий послужил недавний скандал, разразившейся вокруг программы, позволяющей определять сексуальные предпочтения человека по фото. Авторы этой идеи, исследователи из стенфордского университета, утверждают, что своей работой хотели привлечь внимание общественности к новым рискам, которые создают современные технологии.

Но по мнению обозревателей, ученные создали «бомбу, чтобы предупредить людей об опасности бомб». Подобные эксперименты проходили так же в области опознания этнической принадлежности по фотографии и имени человека, а так же в ряде других случаев обработки больших данных. Большинство этих программ заявлялись как антидискриминационные. При этом, все они могут быть использованы и для дискриминации.

На сегодняшний день большинство комитетов по этике, действующих при университетах, руководствуются предписаниями 40-летней давности. Специалисты считают, что для решения проблемы нужны не только новые правила, но и привлечение гуманитариев еще на этапе разработки программ.

Ранее портал "Знай.ua" сообщал о возможности восстания машин