Штучний інтелект створює масу нових можливостей в області соціальних експериментів. Але разом з ними він створює нові загрози для особистого життя і демократії. До цих пір розробники керувалися лише власними принципами. Однак, експерти впевнені, що нову регуляторну базу потрібно було створювати ще вчора, повідомляє Wired.

Підпишись на наш Viber: новини, гумор та розваги!

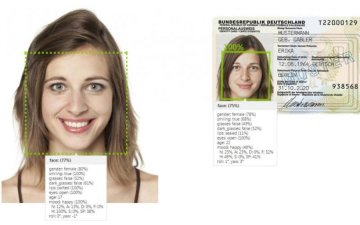

ПідписатисяПричиною для нового витка дискусії про етичні рамки в області цифрових технологій послужив недавній скандал, що вибухнув навколо програми, яка дозволяє визначати сексуальні уподобання людини по фото. Автори цієї ідеї, дослідники зі стенфордського університету, стверджують, що своєю роботою хотіли привернути увагу громадськості до нових ризиків, які створюють сучасні технології.

Але на думку оглядачів, вчені створили «бомбу, щоб попередити людей про небезпеку бомб». Подібні експерименти проходили так само в області впізнання етнічної належності по фотографії та імені людини, а так само в низці інших випадків обробки великих даних. Більшість цих програм заявлялися як антидискримінаційні. При цьому, всі вони можуть бути використані і для дискримінації.

На сьогоднішній день більшість комітетів з етики, що діють при університетах, керуються приписами 40-річної давнини. Фахівці вважають, що для вирішення проблеми потрібні не тільки нові правила, але і залучення гуманітаріїв ще на етапі розробки програм.

Раніше портал "Знай.ua" повідомляв про можливість повстання машин